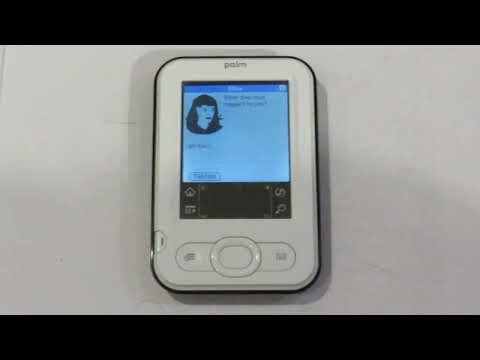

@nytpu @claudiom @kelbot @gemlog @goosey @ParadeGrotesque @dibi58 @Maya You can even have an #AI #assisted #chat with the original #chatbot #Eliza! #palm #pda #palmos #pocketcomputers #retrocomputing #vintagecomputing #vintagecomputers https://youtu.be/Gm3RD9RSLOo

Recent searches

Search options

#eliza

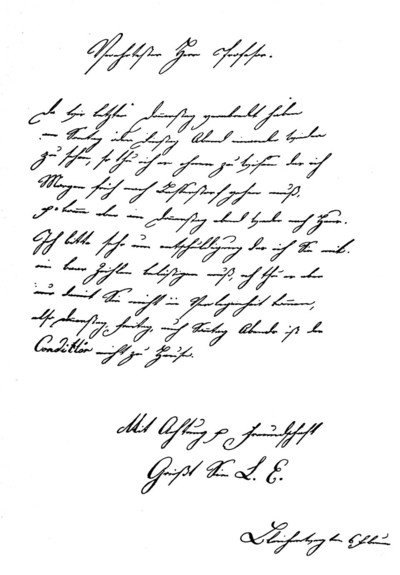

What connects chatbots such as ChatGPT to a 19th century seamstress and the heavy price she paid for falling in love with an upperclass academic?

The foundational chatbot ELIZA was developed in the 1960s by MIT professor Joseph Weizmann to mimic human communication. Weizmann named it after Eliza Doolittle from George Bernard Shaw’s play Pygmalion.

1/4

Would you play a Warhammer 40K factory game? Because Zachtronics almost made one - https://www.rockpapershotgun.com/would-you-play-a-warhammer-40k-factory-game-because-zachtronics-almost-made-one #ZachtronicsIndustries #VisualNovel&Dating; #Birdview/Isometric #ActionAdventure #GamesWorkshop #SinglePlayer #Firstperson #SHENZHENI/O #Simulation #SpaceChem #Strategy #Android #Puzzle #Indie #Eliza #Mac #iOS #PC

Firefox has added an optional side-bar for an AI chat and you can specify which model to use.

Has anyone made it use Eliza yet?

I haven't turned it on, and I am eyeing forks of the software that are against this sort of thing, but if I did turn it on that model would amuse me most.

"Man kann aus der Studie also durchaus auch ableiten, dass fast ein Viertel der Probanden im realen Leben Chat-Verläufe erlebt, welche sich nicht wesentlich von einem empathielosen Textroboter unterscheiden."

Hihi, autsch

https://dnip.ch/2024/07/15/chatgpt-besteht-den-turing-test-gilt-ki-jetzt-als-intelligent/

#eliza #chatgpt #ki #turingtest

@MATAK79

Offensive to both you and #Weizenbaum, who tried to call this out with #ELIZA.

"[Weizenbaum] identified the natural empathy humans have toward one another and the way that this can be misdirected toward computers and recognized the great temptation for technologists to use this empathy to mislead or deceive humans to make a profit, to nudge or persuade them, or to undermine democracy itself.

The Limits of Computation | Weizenbaum Journal of the Digital Society https://ojs.weizenbaum-institut.de/index.php/wjds/article/view/106/96

The ELIZA Archaeology Project: Uncovering the Original ELIZA - Since ELIZA was created by [Joseph Weizenbaum] in the 1960s, its success had led t... - https://hackaday.com/2024/02/22/the-eliza-archaeology-project-uncovering-the-original-eliza/ #naturallanguageprocessing #artificialintelligence #softwaredevelopment #eliza

#Chatbots – egal wie einfach oder komplex gemacht sie sind – nutzen den ELIZA-Effekt: eine Wahrnehmungsverzerrung, die Menschen dazu bringt, tendenziell zu glauben, was gut formuliert ist.

https://en.wikipedia.org/wiki/ELIZA_effect

Die fatale Tendenz, Chatbots zu anthropomorphisieren, wird verstärkt, wenn in diesem Zusammenhang von „künstlicher Intelligenz“ gesprochen wird. Wenn sie LLMs verwenden, dann sagt das und nicht „KI“.

Vielleicht ist es weniger fatal, Chatbots mit Tieren zu vergleichen. @emilymbender hat dafür „stochastische Papageien“ vorgeschlagen.

Wenn ich lese, was @lcamtuf dazu schreibt, bin ich entgegen seiner Empfehlung doch versucht, Chatbots zu vermenschlichen – als Trickbetrüger.

https://lcamtuf.substack.com/p/llms-are-better-than-you-think-at

Weizenbaum ging es nicht um Prognosen, was technisch machbar sein wird. Er war nachhaltig entsetzt über die Reaktionen von Menschen auf sein Programm #ELIZA (1966), das einen Dialog mit einem Psychiater simulierte. Das Buch ist eine ausführliche und tiefgründige Reflexion der Hintergründe. Ich glaube, man kann eine seiner wichtigsten Aussagen in einem ebenso simplen wie wichtigen Satz zusammenfassen:

Mensch und Maschine sind niemals wesensgleich!

2/x

Mike Amundsen

Mike Amundsen